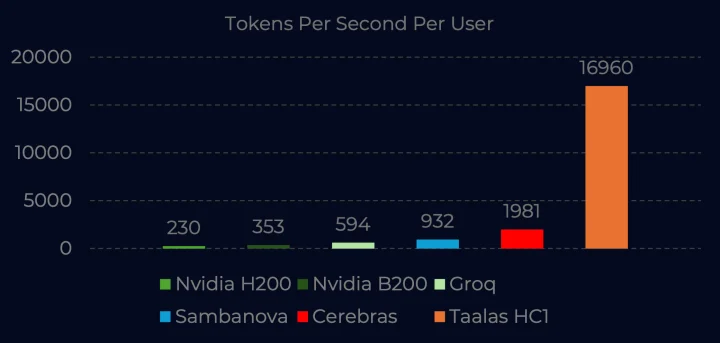

Taalas HC1 เป็นชิปตัวเร่งประมวลผล AI ที่ฮาร์ดไวร์ (hardwired) ไว้กับโมเดล Llama 3.1 ขนาด 8B โดยตรง ให้ประสิทธิภาพการประมวลผลสูงถึงเกือบ 17,000 โทเคนต่อวินาที ซึ่งเหนือกว่าตัวเร่งประมวลผลระดับดาต้าเซ็นเตอร์อย่าง NVIDIA B200 และชิปของ Cerebras Systems

Taalas HC1 มีความเร็วมากกว่าชิปของ Cerebras ประมาณ 10 เท่า ต้นทุนการผลิตต่ำกว่าประมาณ 20 เท่า และใช้พลังงานน้อยกว่าประมาณ 10 เท่า ข้อจำกัดหลักคือสามารถใช้งานได้เฉพาะกับโมเดลที่ถูกฮาร์ดไวร์ไว้ในฮาร์ดแวร์เท่านั้น ซึ่งปัจจุบันคือ Llama 3.1 ขนาด 8B แต่มีการระบุว่ายังคงรักษาความยืดหยุ่นได้ผ่านการปรับขนาด context window และรองรับการทำ fine-tuning ด้วยเทคนิค Low-Rank Adapters (LoRAs)

ตัวเร่งประมวลผลฮาร์ดแวร์โดยทั่วไปมักมีหน่วยความจำอยู่ด้านหนึ่ง และหน่วยประมวลผล (compute) อยู่อีกด้านหนึ่ง ซึ่งทั้งสองส่วนทำงานด้วยความเร็วที่แตกต่างกัน และแบนด์วิดท์ของหน่วยความจำมักเป็นคอขวด (bottleneck) สำหรับโมเดลภาษาขนาดใหญ่ (Large Language Models – LLMs), เทคโนโลยีของ Taalas รวมการจัดเก็บข้อมูลและการประมวลผล (compute) ไว้บนชิปตัวเดียวกัน ที่ความหนาแน่นระดับ DRAM (DRAM-level density) เพื่อเพิ่มประสิทธิภาพอย่างมหาศาลและลดการใช้พลังงานลง

การทำ Ultra-fast inference มีประโยชน์ในเซิร์ฟเวอร์ที่มีผู้ใช้หลายคนเข้าถึงตัวเร่งประมวลผลพร้อมกัน รวมถึงในหุ่นยนต์ที่ใช้การโต้ตอบด้วยเสียง ตัวอย่างที่เราสังเกตเห็นคือระหว่างการรีวิว SunFounder Fusion HAT+ ซึ่งมีการส่งพรอมต์ไปยังบริการ LLM (Gemini AI), จากนั้นระบบจะตอบกลับด้วยอัตราโทเคนต่อวินาทีตามที่กำหนด ก่อนที่เอนจินแปลงข้อความเป็นเสียง (text-to-speech) จะเริ่มทำงานกระบวนการนี้ก่อให้เกิดความหน่วง ทำให้บทสนทนาไม่เป็นธรรมชาติเนื่องจากมีอาการแลค ตอนที่เริ่มเขียนบทความนี้เราคิดว่า Taalas-HC1 อาจนำไปใช้กับงานด้านหุ่นยนต์ได้ แต่เมื่อพิจารณาว่าอุปกรณ์นี้ถูกออกแบบมาสำหรับเซิร์ฟเวอร์ขนาด 2.5kW ก็อาจจะยังไม่เหมาะกับงานลักษณะนั้นในตอนนี้, ชิป HC1 ผลิตด้วยกระบวนการ 6 นาโนเมตรของ TSMC มีขนาดไดประมาณ 815 ตารางมิลลิเมตร และประกอบด้วยทรานซิสเตอร์จำนวน 53 พันล้านตัว

บริษัทได้จัดทำแชตบอทสาธิตออนไลน์, เพื่อให้ทุกคนสามารถทดลองใช้งานได้ และมันก็เร็วมากจริง ๆ โดยระบบรายงานความเร็ว 19,997 โทเคนต่อวินาที เมื่อเราถามว่า “2+2 ได้เท่าไร?” แต่สำหรับคำถามทั่วไปมากขึ้น เช่น “ทำไมท้องฟ้าถึงเป็นสีฟ้า?” หรือ “คุณรู้อะไรเกี่ยวกับ CNX Software?” ระบบประมวลผลที่ประมาณ 15,000–16,000 โทเคนต่อวินาที เราได้ลองทดสอบแบบหนัก ๆ โดยขอให้มันเขียนหนังสือ 100 หน้าเกี่ยวกับความหมายของชีวิต แต่แทนที่จะได้หนังสือเต็มเล่ม ระบบกลับสร้างโครงร่างหนังสือ 14 บทให้แทน ซึ่งถูกสร้างเสร็จในเวลาเพียง 0.064 วินาที ที่ความเร็ว 15,651 โทเคนต่อวินาที ทั้งนี้โมเดลดังกล่าวมีขนาด 8 พันล้านพารามิเตอร์ ดังนั้นคำตอบที่ได้จึงอาจไม่ถูกต้องเสมอไป

ปัจจุบันบริษัทกำลังพัฒนา LLM สำหรับงานด้านการให้เหตุผล (reasoning) ขนาดกลางรุ่นที่สอง ซึ่งยังคงใช้ซิลิคอน HC1 เป็นพื้นฐาน และมีกำหนดเปิดตัวในไตรมาสที่ 2 ต่อจากนั้น แพลตฟอร์มซิลิคอนเจเนอเรชันที่สอง (HC2) จะรองรับความหนาแน่นที่สูงขึ้นและประสิทธิภาพที่รวดเร็วยิ่งกว่าเดิม โดยคาดว่าจะเริ่มทยอยใช้งานจริงได้ภายในช่วงปลายปี สามารถดูรายละเอียดเพิ่มเติมได้จากประกาศอย่างเป็นทางการของบริษัท

แปลจากบทความภาษาอังกฤษ : Taalas HC1 hardwired Llama-3.1 8B AI accelerator delivers up to 17,000 tokens/s

บรรณาธิการข่าวและบทความภาษาไทย CNX Software ได้มีความสนใจในด้านเทคโนโลยี โดยเฉพาะ Smart Home และ IoT