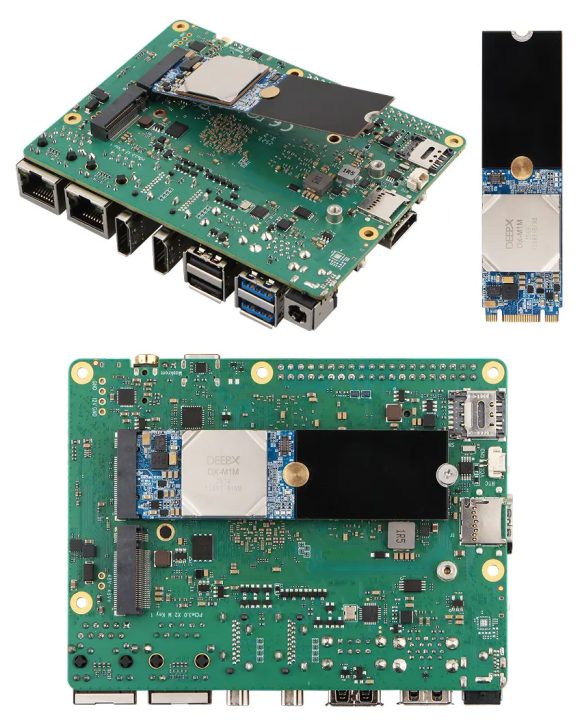

Radxa AICore DX-M1M เป็นโมดูลเร่งความเร็ว Edge AI แบบ M.2 ขนาดกะทัดรัดและใช้พลังงานต่ำ ที่ใช้ neural processing unit (NPU) รุ่น DeepX DX-M1M ให้ประสิทธิภาพ AI สูงสุดถึง 25 TOPS (INT8) ขณะที่ใช้พลังงานเพียง 3 วัตต์เท่านั้น

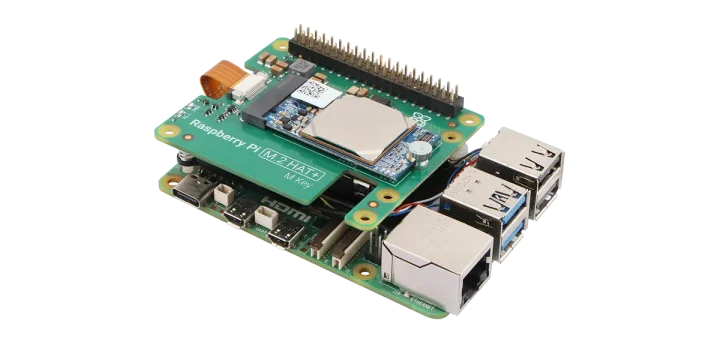

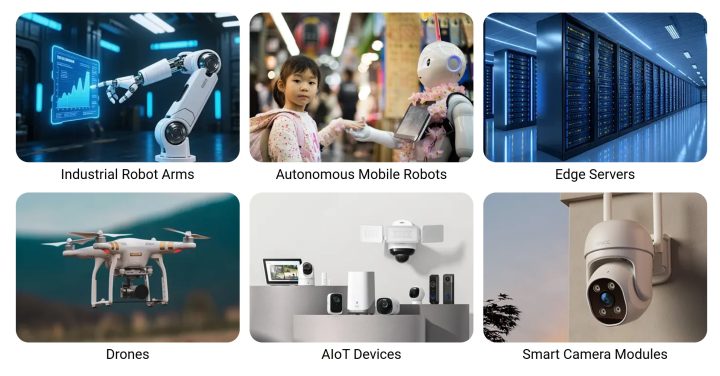

โมดูลนี้ถูกออกแบบมาสำหรับงาน เช่น หุ่นยนต์แขนกลอุตสาหกรรม, หุ่นยนต์เคลื่อนที่อัตโนมัติ (AMR), Edge server, โดรน และอุปกรณ์ AIoT โดยให้ความสามารถด้าน AI และ Machine Learning ประสิทธิภาพสูงโดยไม่กินพลังงานมาก รองรับการเชื่อมต่อผ่าน PCIe Gen3 x2 และใช้งานได้ทั้งกับระบบ x86 และ Arm รวมถึงบอร์ดยอดนิยมอย่าง Raspberry Pi 5 และ Radxa ROCK SBC

สเปค่ของ AICore DX-M1M :

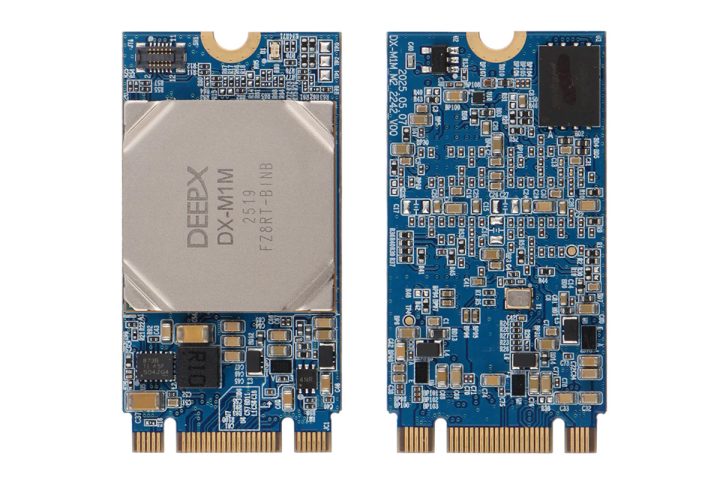

- AI Accelerator – DeepX DX-M1M neural processing unit (NPU) ให้ประสิทธิภาพ AI สูงสุด 25 TOPS

- หน่วยความจำ AI – 1GB LPDDR4X @ 4266 MT/s (อยู่บนชิป รองรับสูงสุด 8GB ตามข้อมูล DeepX)

- หน่วยเก็บข้อมูล – 1Gbit QSPI NAND / NOR Flash

- อินเทอร์เฟซโฮสต์ –PCIe Gen 3.0 x4 (รองรับ Gen1/2/3 และ x1/x2) ผ่านคอนเนกเตอร์ M.2 M + B Key

- การใช้พลังงาน – ประมาณ 3W

- ขนาด – 42 x 22 มม. (ฟอร์มแฟกเตอร์ M.2 2242) รองรับสล็อต M.2 2280 ผ่านอะแดปเตอร์

- ช่วงอุณหภูมิการทำงาน

- -25°C ถึง 65°C (ประสิทธิภาพคงที่ ไม่มีการลดความเร็ว)

- 65°C ถึง 85°C (มีระบบป้องกันความร้อน และลดความเร็วการทำงาน)

Radxa AICore DX-M1M ใช้งานร่วมกับ DEEPX DXNN SDK ซึ่งรองรับการคอมไพล์, ปรับแต่งโมเดล AI และ การประมวลผล inference ด้วย DEEPX NPU แล้วยังรองรับเฟรมเวิร์กยอดนิยม PyTorch, ONNX, TensorFlow และ Keras โดยใช้ DX-COM compiler แปลงโมเดลเป็นฟอร์แมต DXNN เฉพาะของ DeepX

เครื่องมือใน SDK ประกอบด้วย DXRT-NPU-Driver (ไดรเวอร์ PCIe สำหรับเคอร์เนล), DX-RT runtime สำหรับสื่อสารกับ NPU, DX-APP ตัวอย่าง C++ / Python, DX-STREAM, ปลั๊กอิน GStreamer สำหรับวิดีโอแบบเรียลไทม์, DX Model Zoo (โมเดลสำเร็จรูป เช่น ตรวจจับใบหน้า, จำแนกภาพ, ตรวจจับวัตถุ, segmentation และ pose estimation) และ DX-Tron สำหรับแสดงผลและวิเคราะห์โมเดล นอกจากนี้ยังรองรับระบบปฏิบัติการ Windows 10 / 11 และ Ubuntu Linux (20.04 / 22.04 / 24.04 LTS) รวมถึง Docker พร้อมทั้งมีชุดติดตั้งแบบรวดเร็ว

Radxa ยังมี DX-All Suite เป็นแพ็กเกจติดตั้งแบบง่ายที่รวมทั้งตัวคอมไพเลอร์และ runtime ไว้ในชุดเดียว ช่วยให้นักพัฒนาสามารถตั้งค่า DXNN environment ได้ง่ายผ่าน Docker หรือการติดตั้งแบบโลคอล โดยสามารถดูรายละเอียดเพิ่มเติมได้จากคู่มือเริ่มต้นใช้งาน

Radxa AICore DX-M1M มีวางจำหน่ายผ่าน Arace Tech ในราคา $85.00 (~2,800฿) และ Radxa ยังระบุว่าเพื่อให้ได้ประสิทธิภาพที่เสถียรภายใต้การใช้งานต่อเนื่อง ควรใช้ระบบระบายความร้อนแบบแอคทีฟ เช่น Radxa Heatsink 2012B หรือใช้เคสโลหะพร้อมแผ่นระบายความร้อน (thermal pads) โดยสามารถดูรายละเอียดเพิ่มเติมได้จากหน้าผลิตภัณฑ์

แปลจากบทความภาษาอังกฤษ : Radxa AICore DX-M1M M.2 2242 low-power AI module delivers 25 TOPS of edge AI performance for just 3W of power

บรรณาธิการข่าวและบทความภาษาไทย CNX Software ได้มีความสนใจในด้านเทคโนโลยี โดยเฉพาะ Smart Home และ IoT